《LAP: Language-Action Pre-Training Enables Zero-shot Cross-Embodiment Transfer》深度解读

论文信息 - 作者:Lihan Zha, Asher J. Hancock, Mingtong Zhang, Tenny Yin, Yixuan Huang, Dhruv Shah, Allen Z. Ren, Anirudha Majumdar - 机构:普林斯顿大学 Physical Intelligence - 发表时间:2026年2月 - arXiv:https://arxiv.org/abs/2602.10556 - 官方博客:未找到

一句话总结

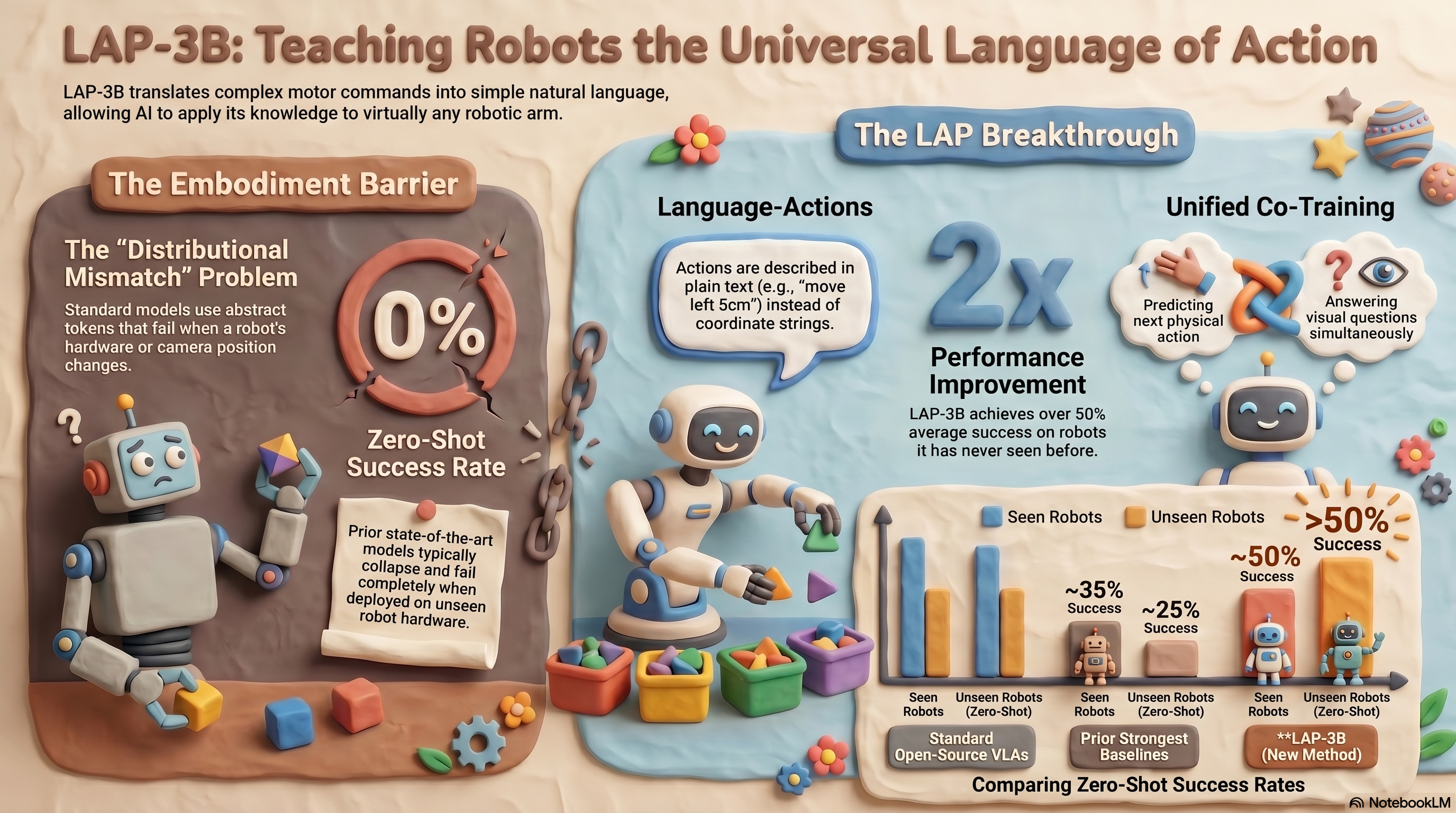

本文提出语言-动作预训练(Language-Action Pre-training, LAP)方法,通过将机器人底层动作直接表示为自然语言描述,解决了现有视觉-语言-动作模型(Vision-Language-Action, VLA)在未见机器人本体(embodiment)上零样本迁移性能差的问题,在真实机器人实验中实现了超过50%的平均零样本成功率,相比之前最强方法提升了约2倍。

背景与动机

构建一个可以零样本部署到新型机器人本体的通用机器人策略(generalist robot policy)仍然是一个未解决的问题。尽管大规模多本体预训练已经取得了不少进展,现有的视觉-语言-动作模型(VLAs)仍然与训练时所用的机器人本体紧密绑定,在新本体上需要昂贵的微调才能工作【原文 §1 Introduction】。

核心挑战在于:机器人本体空间非常大,通过数据覆盖所有本体的成本极高——任务和环境多样性可以通过野外数据扩展,但本体多样性受硬件可用性限制【原文 §1 Introduction】。

本文的关键观察是:零样本跨本体迁移的性能关键取决于预训练视觉语言模型(VLM)如何适配运动控制。机器人既要获得精确控制能力,又要保留支持迁移的语义和视觉表征,但标准的VLA训练会导致分布不匹配(distributional mismatch),破坏预训练学到的知识【原文 §1 Introduction】。

核心方法

核心思路:用自然语言表示动作

LAP的核心思想是训练VLA预测语言动作(language-actions)——对末端执行器(end-effector)动作净效果的自然语言描述(例如"向左移动5厘米")。这些描述是在固定坐标约定和模板下从原始动作解析而来,不需要额外标注【原文 §1 Introduction】。

这种做法避免了标准VLA方案的分布不匹配问题。标准VLA通常使用连续关节/末端命令,或者用任意词元离散化,这些都与预训练VLM的词分布不匹配【原文 §1 Introduction】。

语言动作构建

语言动作是对末端执行器增量运动(delta motions)的自然语言描述,直接从末端轨迹解析,无需人工标注: - 坐标约定:+x 向前,+y 向左,+z 向上,欧拉角遵循右手定则【原文 §3.2】 - 模板描述:平移用"move",滚转/俯仰用"tilt",偏航用"rotate"【原文 §3.2】 - 幅度离散化为整数值(平移单位为厘米)【原文 §3.2】 - 一个语言动作总结一个动作块(action chunk)的净位移,而不是每个时间步生成一个【原文 §3.2】 - 训练时50%用机器人基坐标系,50%用末端坐标系【原文 §3.2】

这种表示的优势:避免分布不匹配,不需要学习动作分词器,自然与VQA(Visual Question Answering)任务格式对齐(例如从图像对预测运动)【原文 §3.2】。

模型架构:混合设计

LAP-3B采用混合设计: 1. VLM主干(PaliGemma-3B):用LAP预训练,负责语言动作预测 2. 轻量化动作专家(action expert):基于流匹配(flow-matching),用于高频连续控制【原文 §3.3】

训练过程: - VLM主干用交叉熵损失优化语言动作预测 - 动作专家通过流匹配目标预测连续动作块 - 整体训练目标结合两个损失 - 通过知识隔离(knowledge insulation)阻止动作专家的梯度回传VLM,保护预训练表征【原文 §3.3】

推理时:只运行动作专家,可达到25Hz控制频率(RTX 4090上)【原文 §3.3】

训练细节

- 数据:Open X-Embodiment (OXE) 数据集 + MolmoAct 数据集【原文 §3.4】

- 本体感觉:笛卡尔末端位姿(位置、连续6D旋转、二值夹爪状态)离散化为255个桶,以文本词元形式追加到prompt【原文 §3.4】

- 训练规模:64块TPU v6e,全局batch size 2048,15k梯度步(约10小时,0.65个epoch)【原文 §3.4】

实验与结果

论文在4种机器人本体、10个真实世界操纵任务、LIBERO仿真基准上进行了评估,共进行了超过1300次真实机器人评估试验【原文 §4 Experiments】。

1. 零样本跨本体迁移

测试设置: - 见过的本体:DROID setup - 未见本体:定制7自由度Franka Panda、6自由度YAM、7自由度Kinova - 任务:每个本体2个任务,每个任务20次试验

结果: - 见过的本体:LAP-3B比π₀.₅-replicated/π₀-replicated高出约15个百分点,与专门在DROID上微调的π₀.₅-DROID性能相当【原文 §4.1】 - 未见本体:LAP-3B达到超过50%的平均零样本成功率,相比最强基线提升约2倍,是唯一一个在所有新本体上都保持高性能的模型;所有开源VLA在未见机器人上都无法生成有意义的行为【原文 §4.1】

2. 新本体上的微调效率

仿真(LIBERO):LAP-3B收敛快得多——1个epoch后达到78%成功率,6个epoch内接近最大值(96.8%);π₀.₅-Oracle经过长时间训练后渐近性能略高,但LAP-3B计算效率更优【原文 §4.2】

真实世界:在两个挑战性任务上(YAM上挂胶带、定制Franka上叠毛巾放入篮子),LAP-3B用20个演示就达到约50%任务进度,比基线少需要2.5倍数据,并且在所有数据规模上都持续优于基线【原文 §4.2】

3. 表征分析

- T-SNE可视化:LAP-3B学到的本体特征在训练本体和未见本体之间有大量重叠,而基线方法π₀.₅-replicated的特征形成分开的簇【原文 §4.3】

- 动作预测误差:LAP-3B在训练过程中对留存的未见本体始终保持更低的预测误差,且下降平滑稳定【原文 §4.3】

4. 与视觉语言数据集联合训练

与运动预测VQA任务(从两张连续图像预测语言动作)联合训练可以提升跨本体性能,产生更精确的动作生成和空间泛化,并且模型更容易适应新任务(微调更快,最终收敛更高)【原文 §4.4】

5. 模型规模缩放

使用Gemma3作为主干,不同规模的LAP模型(4B、12B、27B参数)都表现出一致的验证损失下降和良好的缩放性(容量增加,性能单调提升),而基线方法π₀.₅-replicated在更大规模下会饱和甚至性能下降【原文 §4.5】

亮点与局限

亮点: - 首次在不进行单本体微调的情况下,在未见机器人本体上实现了可观的零样本迁移成功【原文 Abstract】 - 方法简洁优雅:不需要学习分词器,不需要昂贵标注,不需要针对特定本体设计【原文 Abstract】 - 相比之前最强VLA方法,零样本成功率提升约2倍(从~25%到~50%+)【原文 §4.1】 - 微调效率提升:达到相同性能需要的数据减少达2.5倍【原文 §1】 - 支持良好的缩放:模型越大性能持续提升,不像基线在大尺寸下性能下降【原文 §4.5】 - 将动作预测和VQA统一到相同格式,联合训练可以进一步提升性能【原文 §4.4】

局限(原文承认的): - 只关注单臂操纵机器人,尚未测试双臂机器人【原文 §5 Conclusions and Discussions】 - 没有在高控制频率/极高精度场景评估【原文 §5】 - 未来工作方向包括:双臂机器人、人体姿态跟踪/UMI/互联网视频数据、分层/多尺度语言动作表示【原文 §5】

延伸阅读

- 相关方向:这篇工作属于通用机器人策略(generalist robot policy)和视觉-语言-动作模型(VLA)领域

- 相关论文:

- π₀: A Foundation Model for General Robot Manipulation (Google DeepMind)

- OpenVLA: An Open-Source Vision-Language-Action Model

- Open X-Embodiment Dataset 项目

一句话点评:这篇论文的核心洞见很简单但有效——既然我们用预训练VLM就是为了它的语言先验,那为什么不把动作也用语言表示呢?通过自然语言对齐动作分布,解决了跨本体迁移的核心问题,是 robotics 与 foundation model 结合方向的一个重要进展。

完整技术文档及后续更新: https://xrollout.org/blog/lap.zh

我会在网站持续更新 MemoryHub 的工程实现细节和开源进展,欢迎收藏关注。

Comments (0)

Please sign in to leave a comment.