《RL Token: 用视觉-语言-动作模型启动在线强化学习》深度解读

论文信息

- 标题:RL Token: Bootstrapping Online RL with Vision-Language-Action Models

- 作者:Charles Xu, Jost Tobias Springenberg, Michael Equi, Ali Amin, Adnan Esmail, Sergey Levine, Liyiming Ke

- 机构:Physical Intelligence (PI)

- 发表时间:2025年

- 项目主页:https://pi.website/research/rlt

- PDF直链:https://www.pi.website/download/rlt.pdf

一句话总结

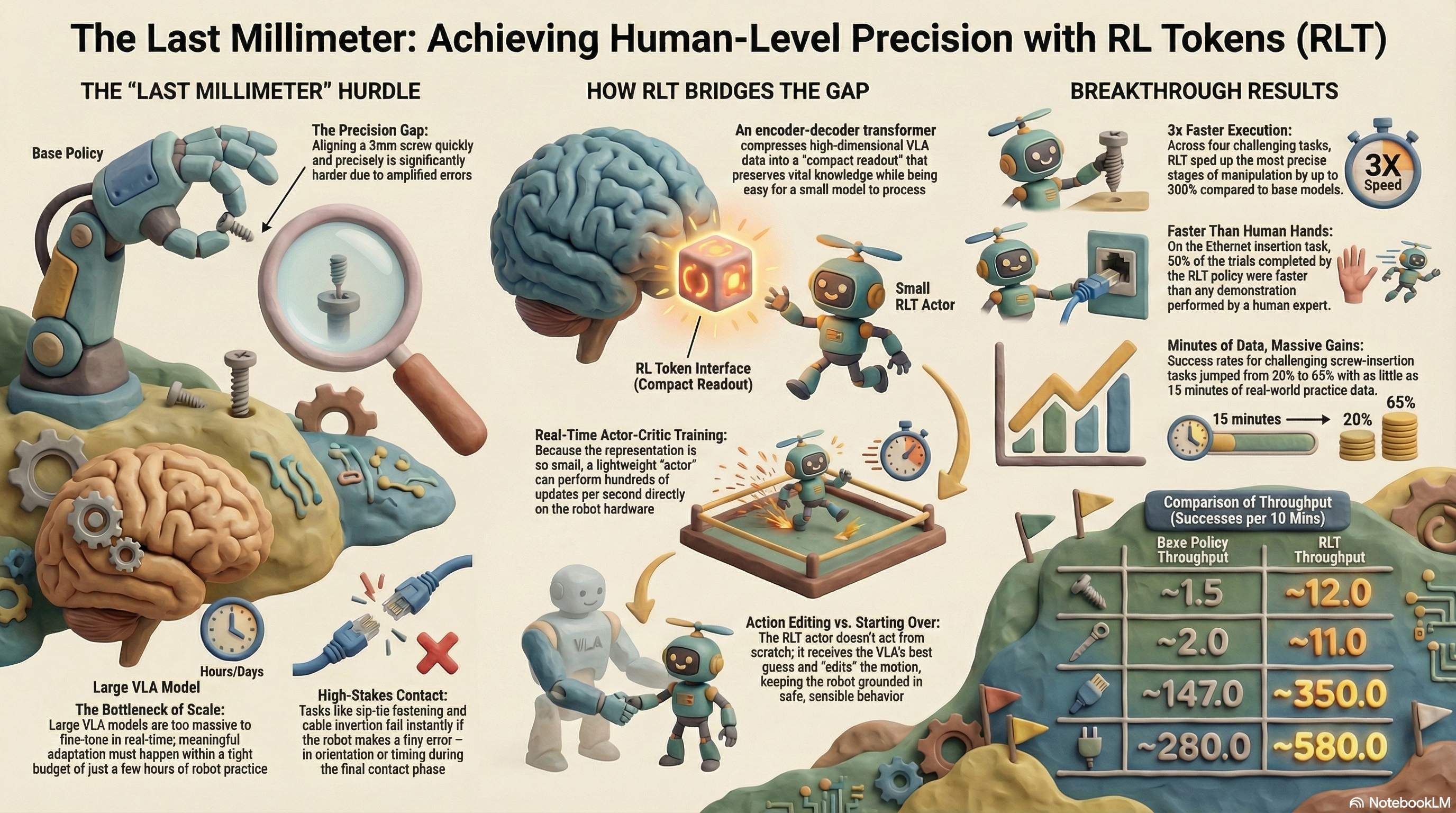

通过从预训练VLA模型中提取紧凑的"RL Token"表示,RLT方法能够在仅几小时的机器人实践中,用轻量级actor-critic网络高效地在线微调大型视觉-语言-动作模型,实现成功率和执行速度的显著提升(高达3倍)。

背景与动机

VLA模型的困境

视觉-语言-动作(Vision-Language-Action, VLA)模型通过学习海量演示数据,能够执行各种多样的操控技能【原文 §1 Introduction】。然而,它们在"最后一公里"的执行上常常力不从心:动作可能很慢,成功完成可能需要暂停和重试,而在关键阶段的微小误差可能导致整个任务失败。

论文原文指出:"General-purpose vision-language-action (VLA) models can learn a wide range of diverse manipulation skills from data. Yet they often struggle in the last millimeter of execution: motions can be slow, successful completion may require pauses and retries, and small errors at critical stages of precise tasks can compound into failure."【原文 §1 Introduction】

为什么需要在线RL微调?

强化学习(RL)提供了一种自然的方式来突破演示数据的性能上限——通过在任务上反复练习,智能体能够发现更快、更精确或更鲁棒的策略【原文 §1 Introduction】。

然而,对VLA进行样本高效的在线微调面临重大挑战: 1. 大规模RL方法依赖海量数据,不适合快速在线适应【原文 §1 Introduction】 2. 数据高效的RL方法通常只训练小型模型,牺牲了VLA的泛化能力【原文 §1 Introduction】

核心问题因此是:如何在保持VLA泛化能力的同时,实现轻量级在线RL的速度和样本效率?

核心方法

核心思想:RL Token

RLT的核心创新是RL Token——一种从VLA内部特征中提取的紧凑、有意义的表示,它保留了任务相关的预训练知识,同时作为在线RL的高效接口【原文 §1, Fig. 1】。

论文将VLA比作一个"黑盒"专家:"the VLA's high-dimensional embeddings are not obviously structured for RL"【原文 §4-A】。为此,他们训练了一个轻量级的encoder-decoder Transformer,将VLA的最终层token嵌入压缩成一个小向量(RL Token),同时通过重构任务确保该表示保留了足够的信息。

具体实现上,RL Token通过以下公式计算【原文 §4-A, Eq. (1)】:

z_rl = g_φ([z_1:M, e_rl]_{M+1})

其中:

- z_1:M 是VLA的M个输入token嵌入

- e_rl 是一个可学习的特殊token

- g_φ 是轻量级encoder transformer

然后通过decoder transformer d_φ 自回归地重构原始嵌入,训练目标是最小化重构误差【原文 §4-A, Eq. (2)】。

Actor-Critic在线微调

获得RL Token后,方法冻结VLA,并在该紧凑表示上训练轻量级的actor-critic网络【原文 §4-B】。关键设计包括:

1. 参考动作条件化(Reference Action Conditioning)

与从头生成动作不同,RL actor π_θ 以VLA提出的动作块为参考进行条件化:

π_θ(a_{1:C}|x,ã_{1:C}) = N(μ_θ(x,ã_{1:C}), σ²I)

【原文 §4-B, Eq. (4)】

这使得在线RL成为对良好VLA先验的"局部精炼",而非无约束搜索【原文 §4-B】。

2. BC正则化

为防止actor偏离VLA太远,训练时加入对参考动作的L2正则项【原文 §4-B, Eq. (5)】:

L_π(θ) = E[-Q_ψ(x,a) + β||a - ã||²₂]

3. 参考动作dropout

为了防止actor简单地复制参考动作而不学习改进,训练时随机将50%的参考动作替换为零向量,强制actor保持独立生成动作的能力【原文 §4-B】。

关键阶段针对性改进

为提升训练效率,RLT专门针对每个任务的关键阶段(critical phase)进行改进——即需要高精度的插入、紧固或旋转阶段【原文 §5】。系统先由基础VLA执行简单部分,在关键阶段前切换到RL策略,将数据收集和信用分配集中在最需要在线适应的部分。

实验与结果

评估任务

实验在四个真实机器人任务上进行,每个都需要灵巧控制和亚毫米级精度【原文 §6-A, Fig. 3】:

| 任务 | 描述 | 难度 |

|---|---|---|

| 螺丝安装 | 使用电动螺丝刀将M3螺丝拧入螺纹孔 | 极高:螺丝可能不竖直,视觉线索主要来自另一侧腕部相机 |

| 扎带紧固 | 将扎带尾部穿过狭窄的锁定槽 | 极高:涉及可变形物体的协调双臂控制 |

| 网线插入 | 将网线连接器插入凹陷端口 | 高:需要准确的位置和角度对齐 |

| 充电器插入 | 将充电器插入电源插座 | 高:插头和插座并非始终可见 |

核心结果

Q1:RLT是否优于基础VLA?

在受控的关键阶段评估中,RLT在所有四个任务上都持续提升成功率和执行速度【原文 §6-C, Fig. 4, Fig. 5】:

- 难度较低的任务(充电器、网线):基础VLA已较可靠,RLT将关键阶段速度提升约3倍

- 难度较高的任务(螺丝刀、扎带):RLT显著提升成功率,例如螺丝插入任务从20%提升至65%

在全任务评估中,由于前期阶段的复合误差,整体成功率较低,但RLT仍将螺丝任务成功率提升40%,扎带任务提升60%【原文 §6-C】。

Q2:与替代RL方法相比如何?

论文对比了四个基线方法【原文 §6-B, Fig. 6】:

| 方法 | 特点 | 表现 |

|---|---|---|

| HIL-SERL | 单步在线RL,使用ResNet编码器 | 失败,无法处理长时程稀疏奖励任务 |

| PLD | 残差策略,单步预测 | 表现差,没有动作分块无法有效学习 |

| DSRL | 在扩散噪声空间学习策略 | 成功率可比,但吞吐量显著低于RLT |

| DAgger | 在人类干预数据上微调VLA | 受限于人类演示速度,提升有限 |

RLT匹配基础策略的高成功率,同时将平均完成步骤减少2倍【原文 §6-C】。

Q3:各组件贡献度如何?

消融实验显示四个设计选择都很重要【原文 §6-C, Fig. 7, Fig. 8】:

- w/o RL Token:用ResNet-10替换,吞吐量下降50%,证实RL Token编码了操作相关的结构信息

- w/o Chunk(单步动作):无法可靠匹配基础策略性能,信用分配问题严重

- w/o BC Regularizer(β=0):性能下降最大,actor被迫仅用Q函数梯度探索

- w/o Pass-Through:学习变慢,早期探索漂移,更多失败

Q4:RLT是否发现更优策略?

论文通过可视化揭示了定性变化【原文 §6-C, Fig. 9】。基础VLA在接近接触时常表现出"试探"行为:接近、后退、重新调整、再尝试——有时循环多次才成功。

相比之下,RLT学会:接近端口后流畅插入,即使首次失败也会施加压力并轻微晃动连接器以利用柔顺性,从而实现更快插入。这种策略在演示数据中不存在,纯粹来自在线探索。在某些任务上,RLT策略甚至超越了人类专家遥操作的速度。

亮点与局限

亮点

- 极高效样本利用:RLT在仅5分钟关键阶段数据(总实验时间约40分钟)后即可超越基线方法【原文 Fig. 7】

- 速度突破:在关键阶段实现高达3倍速度提升,某些任务上超过人类遥操作速度

- 模块化设计:冻结大型VLA,只训练轻量级actor-critic(2-3层MLP),计算高效

- 保留泛化能力:通过RL Token机制,保留了VLA的视觉-语言理解能力

- 真实机器人验证:四个真实任务,涉及高难度接触-rich操作,非仿真结果

局限(原文承认的)

论文在结论部分明确指出【原文 §7 Conclusion】:

- 需要人工干预:训练期间需要人工提供奖励信号、干预修正、以及在RL(关键阶段)和基础策略(其他阶段)之间切换

- 未来改进方向:原则上这些组件可以自动化,例如使用奖励模型和进度预测

局限(解读者补充)

- 任务特定性:RL Token需要为每个任务训练(1-10小时演示数据)

- VLA依赖:方法设计依赖于π₀等特定架构的VLA,对其他架构可能需要调整

- 关键阶段需人工识别:当前需要人工判断何时切换到RL策略

相关工作对比

论文将RLT与近期VLA的RL微调方法进行了细致对比【原文 §2 Related Work】:

| 方法 | 更新范围 | 动作空间 | 核心机制 | 与RLT差异 |

|---|---|---|---|---|

| RECAP [3] | 全VLA模型 | 单步+分块 | 离线RL+优势加权 | RLT冻结VLA,更高效 |

| PPO/VLA [1,26,27] | 全VLA | 单步 | 在线PPO | 难以扩展到真实世界样本高效RL |

| ConRFT [28] | 仅action head | 单步 | 一致性训练+二分类奖励 | 无动作分块,短时程任务 |

| Policy Decorator [29] | 残差策略 | 单步 | 残差×超参数 | 仅仿真验证,需百万步 |

| PLD [30] | 单步残差 | 单步 | Cal-QL预训练critic | 单步,无分块 |

| GR-RL [2] | 噪声预测器 | 分块 | 离线BC+在线噪声学习 | 多阶段复杂流程 |

| DSRL [32] | 潜空间策略 | 分块 | 潜空间RL调制扩散 | 探索受限于VLA生成空间 |

| RLT(本文) | 轻量actor-critic | 分块 | RL Token+参考动作条件化 | 冻结VLA,高效在线学习 |

RLT的关键区别在于: 1. 引入RL Token作为紧凑表示,保留VLA结构同时实现高效RL 2. 使用与VLA原生接口对齐的动作分块,缩短有效决策时程 3. Actor直接以VLA采样的参考动作为条件,并正则化朝向它,将在线RL转化为对良好先验的局部精炼

延伸阅读

VLA基础模型: - π₀: Physical Intelligence的VLA流模型 - OpenVLA: 开源视觉-语言-动作模型 - GR00T N1: NVIDIA人形机器人基础模型

VLA的RL微调方法: - π* (RECAP): 通过经验学习的VLA - ConRFT: 基于一致性策略的VLA强化微调 - DSRL: 潜空间强化学习引导扩散策略

样本高效的机器人RL: - SERL: 样本高效的机器人强化学习软件套件 - HIL-SERL: 人在环中的精确灵巧操作

技术资源: - Pi官方博客:https://pi.website/research/rlt - 论文PDF:https://www.pi.website/download/rlt.pdf - 相关博文:本站的 Attention Residuals机制解析、内存即服务 也涉及VLA的高效微调主题

解读日期:2026年3月28日 解读基于论文原文和作者提供的技术资料

Comments (0)

Please sign in to leave a comment.