MEM: Multi-Scale Embodied Memory 深度解读

论文信息

- 作者:Marcel Torne, Karl Pertsch, 等 (Physical Intelligence)

- 发表时间:2026年3月

- 项目主页:https://www.pi.website/research/memory

- PDF:https://www.pi.website/download/Mem.pdf

一句话总结

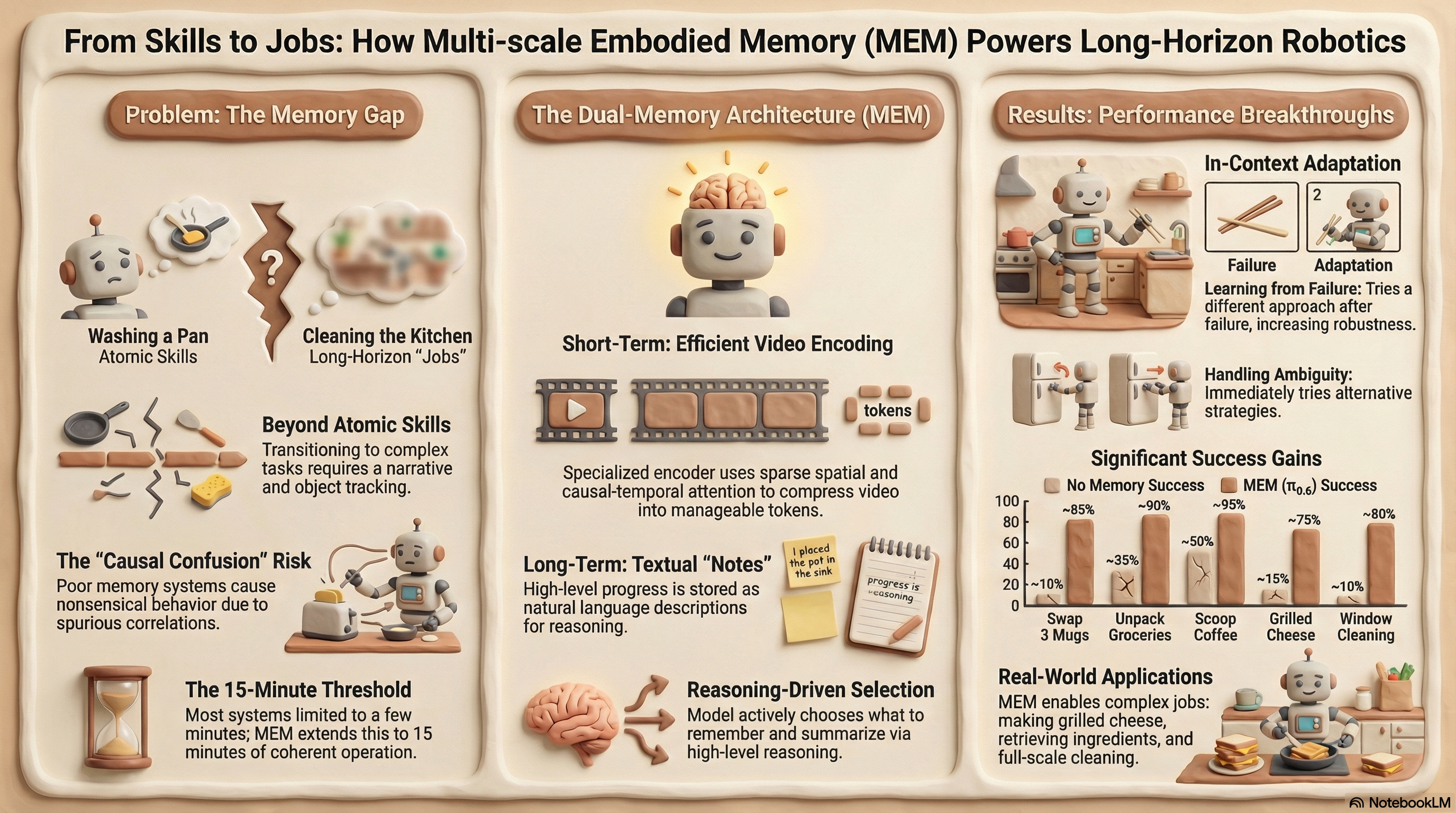

本文提出了多尺度具身记忆(Multi-Scale Embodied Memory, MEM),这是一种为视觉语言动作模型(VLAs)配备长短时记忆的混合模态架构,通过短期视频编码保存密集视觉信息、长期语言记忆压缩语义事件,使机器人能够完成长达15分钟的长周期复杂操作任务,如整理厨房、制作烤奶酪三明治等。

背景与动机

传统的端到端机器人学习中,记忆机制通常是将所有过去观测序列直接输入策略网络【原文 Abstract】。但在复杂的多阶段真实世界任务中,机器人需要在不同抽象层次上表示过往事件:

- 长期记忆:需要记住哪些食谱步骤已经完成(语义抽象)

- 短期记忆:需要记住被机械臂遮挡后的物体位置(密集观测)

论文指出,简单地将所有历史观测都输入模型在长任务中会变得不可计算,要么只能使用非常短的序列,要么需要大幅降采样【原文 §1 Introduction】。

现有的研究工作存在以下不足:

- 循环记忆(recurrent memory)和Transformer全序列方法难以扩展到非常长的时间范围【原文 §1 Introduction】

- 潜记忆架构仅在短任务上评估【原文 §1 Introduction】

- 各种启发式压缩方法(关键点、纯语言记忆等)都存在局限性:单纯的本体感觉、点迹或自然语言都会丢失精确的空间信息;关键点方法需要剧烈稀疏化,在长期任务中可能丢失信息【原文 §1 Introduction】

核心洞察:有效的记忆架构应该组合多种模态来捕捉不同抽象层次【原文 Abstract】。

核心方法

MEM的核心思想是分而治之:用两种不同的记忆机制分别处理短期和长期需求,组合成多尺度记忆系统。

整体架构

MEM将动作预测分解为两个层次【原文 §III-A Multi-Scale Embodied Memory】:

$$ \begin{aligned} \pi(a_{t:t+H}, l_{t+1}, m_{t+1} | o_{t-K:t}, m_t, g) \\ \approx \pi_{LL}(a_{t:t+H} | o_{t-K:t}, l_{t+1}, g) \cdot \pi_{HL}(l_{t+1}, m_{t+1} | o_t, m_t, g) \end{aligned} $$

其中:

- $\pi_{HL}$(高层策略):维护和更新长期语言记忆$m_{t+1}$,并生成下一个子任务指令$l_{t+1}$

- $\pi_{LL}$(低层策略):基于短期视频记忆$o_{t-K:t}$和子任务指令$l_{t+1}$,预测连续的机器人动作

这个分解使得:

- 长期语义信息通过压缩的语言表示保存,可以跨度十几分钟

- 短期密集视觉观测通过视频编码器处理,保持精确空间信息

- 总计算量可控,满足实时推理延迟要求【原文 §III-A】

长期语言记忆(Long-Term Text Memory)

语言记忆$m_t$是机器人执行任务过程中过往语义事件的自然语言摘要【原文 §III-B】。核心设计:

-

增量式更新:高层策略$\pi_{HL}$基于前一个记忆$m_t$、当前观测$o_t$和任务目标$g$,预测更新后的记忆$m_{t+1}$。模型自主决定何时更新以及如何压缩信息【原文 §III-B】。

-

LLM生成训练标签:训练数据通过现成大语言模型自动生成。将已完成的子任务和成败标签输入LLM,让LLM生成对未来仍相关的信息摘要【原文 §III-B】。

-

主动压缩:LLM被指令删除不再需要的信息。例如,不需要记住"我放了一个浅绿色碗、一个深蓝色碗、一个亮黄色碗到右上橱柜",只需要记住"我把三个碗放在右上橱柜"即可,大幅压缩上下文【原文 §III-B】。

这种设计解决了"朴素拼接"方案的痛点:如果简单拼接所有历史子任务指令,推理时会因为失败重复尝试导致分布偏移(训练数据中每个子任务通常只出现一次,推理时可能重复多次)。MEM通过只在成功后更新记忆,减少了这种偏移【原文 §IV-A】。

视频编码器(Dense Short-Term Visual Memory)

为了在保持性能的同时高效压缩数十秒观测,论文对标准ViT(Vision Transformer)进行修改,设计了时空可分离注意力的视频编码器【原文 §III-C】:

- 结构修改:每4层插入一层时间注意力,将空间注意力和时间注意力分离,复杂度从$O(n^2K^2)$降到$O(Kn^2 + nK^2)$【原文 §III-C】

- 渐进压缩:在ViT高层丢弃过去时间步的patch,只传递当前时间步的表示给VLA主干,使得token数量与单帧输入相当【原文 §III-C】

- 零参数初始化:通过修改注意力模式和添加固定正弦位置编码实现,不需要引入新的可学习参数,可以直接从预训练单帧ViT初始化【原文 §III-C】

关键结论:这种设计让推理延迟保持在实时要求(300ms)以内,即使输入16帧总时间超过半分钟的视频,推理时间仍在2.5秒以内,而朴素方法输入8帧就已经超过3秒【原文 Figure 3】。

整合到π0.6 VLA

作者在现有π0.6模型基础上构建了π0.6-MEM:

- 基于Gemma3-4B VLM初始化【原文 §III-D】

- 本体感觉通过线性投影编码,避免长序列文本token爆炸【原文 §III-D】

- 预训练使用混合数据:遥操作演示、策略rollout数据、视频语言数据【原文 §IV-A】

实验与结果

1. 长周期任务测试

在两个极具挑战性的长周期任务测试【原文 §IV-A】:

- 食谱准备:机器人需要从冰箱、橱柜、抽屉中取出食谱指定的所有食材和厨具,放到指定位置,需要记住哪些已经取出、记得关上抽屉柜门,任务时间可达十几分钟

- 厨房清洁:需要擦拭台面、清洗餐具、归位杂物,记住哪些表面已经清洁、是否已经加肥皂等,平均包含8个子任务

实验结果:

| 方法 | 平均任务进度 |

|---|---|

| π0.6 (无记忆) | ~25% |

| 仅视频记忆 | ~38% |

| 仅语言记忆 | ~43% |

| 朴素文本+视频记忆 | ~48% |

| π0.6-MEM (Ours) | ~70% |

结论:两个组件(短期视频记忆 + 长期语言记忆)都是必需的,结合之后性能大幅提升,比单独使用任一组件都高很多【原文 §IV-A】。

2. 上下文内策略适应(In-Context Adaptation)

MEM的短期记忆使得机器人能够从失败中学习,在上下文中调整操作策略【原文 §IV-B】:

测试任务:

- 夹筷子:桌子高度分布外,机器人经常抓不住,人类在失败后给出正确抓取高度演示

- 开冰箱门:铰链在哪一侧不明显,机器人经常从错的方向尝试,人类给出正确方向演示

结果:带记忆的MEM成功率比无记忆基线高11%,从约64%提升到75%【原文 Figure 7】。这说明记忆能让机器人记住之前失败的尝试,并利用这些信息调整策略,而不是重复失败【原文 §IV-B】。

3. 与现有记忆方法对比

在一套覆盖多种核心记忆能力的测试任务上对比:

- 部分可观测性处理(找隐藏物体、交换杯子、拆包装)

- 计数(加两勺咖啡)

- 定时(烤三明治需要等正确时间)

- 空间记忆(擦窗户记住哪些区域已擦)

结果(平均任务进度):

- 无记忆:约40%

- Pool Memory(平均池化压缩):约55%

- Proprio Memory(仅本体记忆):约60%

- Ours (MEM):约78%

MEM是唯一一个在所有测试任务上都表现良好的方法【原文 §IV-C】。

4. 不损失无记忆任务性能

论文验证了添加记忆不会损害不需要记忆的任务:在10个复杂灵巧操作任务上,MEM的性能与最先进的无记忆VLA(π0.6)相当【原文 Figure 10】。这说明MEM的记忆机制不会导致性能退化。

亮点与局限

亮点:

- 【创新架构】提出分尺度多模态记忆架构,短期用密集视频编码,长期用压缩语言摘要,兼顾效率和效果【原文 §1】

- 【工程完整】完整集成到现有VLA(π0.6)中,在真实机器人上验证了长达15分钟任务的可行性【原文 §IV-A】

- 【通用性】不仅能解决长周期任务,还能支持上下文内错误适应,在不需要记忆的任务上也不损失性能【原文 §IV-B, §IV-C】

- 【效率】推理延迟满足实时约束,16帧(54秒)视频输入仍能在2.5秒内完成推理【原文 Figure 3】

局限(原文承认的):

- 目前记忆只持续单个任务回合(episode),无法跨多个任务场景累积知识【原文 §V Conclusion】

- 文章提到未来工作可以探索将记忆扩展到数周、数月、数年,让机器人在部署时持续学习【原文 §V】

局限(解读者补充):

- 语言记忆依赖LLM生成训练标签,虽然自动但仍间接依赖大模型能力(此为解读者推断,非原文明确表述)

- 评估主要在厨房场景,需要在更多不同领域验证泛化性(此为解读者推断,非原文明确表述)

结论

这篇论文是具身智能大模型方向一个非常重要的进展——它实实在在地解决了"机器人如何完成十几分钟长任务"这个关键问题,证明了分尺度多模态记忆是一条可行之路。

附:RoboMME - 机器人通用策略记忆基准测试深度解读

这是同期另一篇关于机器人记忆的重要研究,提供了标准化基准测试,帮助我们系统性理解不同记忆设计的优劣。

论文信息

- 标题:RoboMME: Benchmarking and Understanding Memory for Robotic Generalist Policies

- 作者:Yinpei Dai, Hongze Fu, Jayjun Lee, Yuejiang Liu, Haoran Zhang, Jianing Yang, Chelsea Finn, Nima Fazeli, Joyce Chai

- 机构:密歇根大学、斯坦福大学、Figure AI

- 发表时间:2026年3月

- arxiv:https://arxiv.org/abs/2603.04639

- 项目主页:https://robomme.github.io/

一句话总结

RoboMME 是第一个大规模标准化机器人记忆增强操作基准测试,基于认知心理学将记忆分为时间记忆、空间记忆、物体记忆、程序记忆四大类,共16个任务77万时间步;基于 π0.5 backbone 构建了14种不同记忆增强VLA变体,系统性研究发现没有任何一种记忆表示能在所有任务上都领先,效果高度任务依赖——符号记忆擅长计数和视觉定位,感知记忆对时间敏感行为和运动模仿至关重要。

背景与动机

近年来,VLA(Vision-Language-Action)模型开始整合记忆机制,但评估局限在狭窄、非标准化的设置中【原文 Abstract】。这带来几个问题:

- 不同记忆设计使用不同 backbone 和评估协议,难以系统性比较

- 现有基准要么不需要真正的记忆(局部感知就能解决),要么任务简单、几乎已被解决【原文 §1 Introduction】

- MemoryBench 只有3个简单任务,MIKASA-Robo 都是短范围任务,缺乏大规模高质量演示【原文 §2 Related Work】

- 因此,缺乏一个能捕捉真实记忆需求的标准化测试集,阻碍了该领域系统性进展【原文 §1】

基准构建:四种记忆类型

论文从认知心理学的经典记忆分类出发【原文 §3.1】,构建了四个任务套件共16个任务:

| 记忆类型 | 任务套件 | 核心能力 | 示例任务 |

|---|---|---|---|

| 时间记忆 (Temporal Memory) | Counting | 积累和排序历史事件 | BinFill(数绿色方块放进箱子,到数量就停止)、Pick Swing(按次数摆动) |

| 空间记忆 (Spatial Memory) | Permanence | 遮挡和场景变化下跟踪物体位置 | CubeSwap(交换位置后找出原物体)、HighlightRepick(记住高亮过的物体) |

| 物体记忆 (Object Memory) | Reference | 跨时间根据引用线索识别物体 | VideoButtonPick(记住视频中哪个按钮被按了)、PlaceCube(记住位置放方块) |

| 程序记忆 (Procedural Memory) | Imitation | 复制之前演示的运动模式 | PatternLock(跟着视频画轨迹)、RouteStick(跟着视频绕过障碍物) |

总计:1600个演示,770k高质量时间步,足够支持大规模模仿学习【原文 §3.1】。

研究方法:14种记忆增强VLA变体

作者在同一个 π0.5 backbone 上构建了三种不同记忆表示,每种又结合三种整合策略,共14种变体【原文 §4】:

三种记忆表示

- 符号记忆 (Symbolic Memory):用可解释的语言子goal表示历史。每一步,辅助VLM根据当前图像和之前的子goal生成下一个子goal。

- SimpleSG:纯文字描述(如"pick up the green cube")

- GroundSG:带坐标接地(如"pick up the green cube at [63, 152]")

-

不同VLM:Gemini-2.5-Pro(零样本)、Qwen3-VL-4B(微调)、Oracle(真值)【原文 §4.1】

-

感知记忆 (Perceptual Memory):从过去图像中提取视觉token序列。两种选择策略:

- TokenDrop:基于RGB差异移除时间冗余patch

-

FrameSamp:均匀间隔采样帧【原文 §4.1】

-

循环记忆 (Recurrent Memory):通过迭代更新将历史压缩为固定大小隐状态:

- TTT(Token-To-Token)

- RMT(Recurrent Memory Transformer)【原文 §4.1】

三种整合策略

对于感知记忆和循环记忆,有三种方式整合到VLA中:

- memory-as-context:将记忆embedding追加到输入,联合处理

- memory-as-modulator:通过自适应 LayerNorm 调节中间激活,条件化action expert

- memory-as-expert:添加一个专门的memory expert,通过分块因果注意力与action expert交互【原文 §4】

主要实验结果

核心发现

论文通过系统性实验得到三个关键结论【原文 §5.2 Key Takeaways】:

- 没有一种表示或整合策略能在所有任务上都占据主导

- 符号记忆在计数和视觉接地任务上表现出色

- 感知记忆对时间敏感行为和运动模仿至关重要

- memory-as-modulator是感知记忆最有效的整合策略【原文 §5.2】

具体数据分析

人类表现平均 90.50%,各种方法中表现最好的是:FrameSamp+Modul(感知记忆 + memory-as-modulator)达到 55.56% 平均成功率【原文 Table 3】。

按任务分类来看:

| 方法 | Counting | Permanence | Reference | Imitation | 平均 |

|---|---|---|---|---|---|

| π0.5 (无记忆) | 49.1 | 15.0 | 25.3 | 19.4 | 27.2 |

| SimpleSG+QwenVL | 85.8 | 44.7 | 33.1 | 22.0 | 46.4 |

| GroundSG+Oracle | 85.8 | 49.7 | 49.6 | 15.6 | 50.2 |

| FrameSamp+Modul | 73.3 | 55.6 | 43.9 | 49.4 | 55.6 |

| TokenDrop+Modul | 73.3 | 52.8 | 42.5 | 45.0 | 53.4 |

| Recurrent+Modul | 68.3 | 50.0 | 42.5 | 42.2 | 50.8 |

可以清楚看出:

- 符号记忆在 Counting 任务上远胜其他方法(85.8 vs 73.3)

- 感知记忆在 Imitation 任务上大幅领先(49.4 vs 15.6-22.0)

- 空间和物体记忆任务上,感知记忆也优于符号和循环【原文 Table 3】

整合策略比较

对于感知记忆,三种整合策略对比:

- memory-as-modulator consistently 优于另外两种【原文 §5.2】

- 原因可能是:modulator 不改变原有计算路径,只是调节激活,对原模型破坏较小

与已有方法比较

对比四个现有方法:

| 方法 | 平均成功率 |

|---|---|

| π0.5 (no memory) | 27.2 |

| π0.5 + past actions (UniVLA) | 32.8 |

| SAM2Act+ | 35.8 |

| MemER | 49.4 |

| FrameSamp+Modul (Ours) | 55.6 |

所有记忆增强方法都优于无记忆基线,证明记忆确实有用,而本文提出的框架取得了最好结果【原文 §5.2】。

亮点与意义

亮点:

- 这是第一个大规模、标准化、多样化的机器人记忆基准,填补了领域空白【原文 §1】

- 基于同一 backbone 系统性比较了14种不同记忆设计,结论可信

- 实证研究得出非常重要的结论:没有万能记忆设计,效果高度任务依赖,这对未来研究有重要指导意义【原文 §5.2】

- 开源了基准和所有模型代码,方便社区继续在此基础上推进【原文 Abstract】

局限(原文承认的):

- 目前所有评估都在仿真环境中进行,还需要在真实机器人上验证【原文 §6 Conclusion】

- 论文只比较了静态设计,没有探索自适应选择记忆机制的可能性【原文 §6】

对领域影响:

- 这个基准将成为未来记忆增强机器人政策研究的标准测试平台

- 结论"效果高度依赖任务类型"提醒研究者:不能指望一种银弹解决所有记忆问题,需要根据任务场景选择合适架构

与 MEM 的关系

Physical Intelligence 的 MEM【前文解读】也是一种混合方法:短期用感知/视频记忆,长期用符号/语言记忆。这正好印证了 RoboMME 的结论——混合方法结合各自优势,符号处理长期语义,感知处理短期细节,分工合作才是正道。

两篇论文互相印证:RoboMME 从基准测试角度验证了"没有单一最优",MEM 从架构创新角度实践了"混合不同记忆类型",共同推进了机器人记忆领域的发展。

Comments (0)

Please sign in to leave a comment.